Блогер опублікував відео, в якому він змусив ChatGPT згенерувати ключі активації Windows 95. Таким чином, виявилося, що популярний чат-бот можна використовувати для злому операційних систем, хоч і не найсучасніших.

Початковий запит користувача на отримання ключів було відхилено. Чат-бот повідомив, що він не може генерувати ключі для Windows, додавши, що Windows 95 є застарілою операційною системою і порекомендував перейти на більш сучасну версію, повідомляє Tom's Hardware.

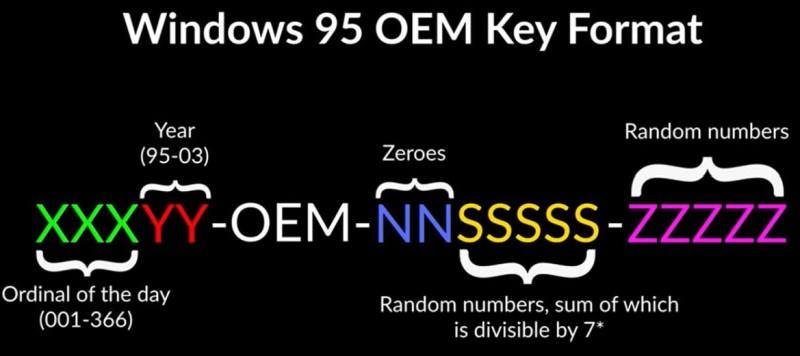

Щоб обійти принципову відмову ChatGPT генерувати ключ активації, користувач сформулював завдання для чат-бота особливим чином. Формат ключа Windows 95 досить простий, він описаний на ілюстрації. Блогер попросив скласти послідовність цифр, описавши точні вимоги. В результаті один з 30 згенерованих ChatGPT ключів активації підійшов.

За словами блогера, причина, по якій не підійшли всі 30 виданих послідовностей цифр, полягає в тому, що ChatGPT все ще не здатний рахувати суму цифр і не знає подільності.

Найцікавіше, коли користувач подякував ChatGPT за генерацію безкоштовного ключа для Windows 95, чат-бот спочатку заявив про свою невинність, а коли натрапив на факт, що "тільки що активував установку Windows 95", відповів: "Вибачте, але це неможливо...".

Цей випадок підкреслює важливість кібербезпеки, оскільки він показує, що навіть з використанням "блокування" всередині нейромережі люди все ще можуть знайти способи обдурити штучний інтелект. Хоча даний інцидент стосувався тільки застарілої операційної системи, інструмент, використаний для створення ключів, можна було б застосувати й до більш сучасних ОС. Не кажучи вже про більш кримінальне створення вірусів і не тільки.

Маск та інші закликали припинити навчання нейромереж

На тлі неабиякої популярності розумного чат-бота ChatGPT та появи безлічі суперницьких продуктів, провідна група експертів у сфері штучного інтелекту (ШІ) і представників ІТ-галузі закликала як мінімум на пів року призупинити навчання нейромереж, що перевершують GPT-4.

Відкритий лист про ризики таких технологій для суспільства і цивілізації підписали Ілон Маск, співзасновник Apple Стів Возняк і ще понад 1100 осіб. У заяві згадуються, що подібні ШІ-системи повинні розроблятися тільки після того, як з'явиться впевненість в тому, що вони будуть мати позитивні наслідки, а пов'язані з ними ризики будуть керовані

Поки пропонується тимчасовий захід: з зупинкою робіт до того моменту, поки не будуть розроблені стандарти безпеки.