Безпілотник зі штучним інтелектом (ШІ) намагався вбити свого оператора під час військової симуляції, тому що той заважав йому досягти мети.

Про це розповів начальник відділу випробувань і операцій штучного інтелекту ВПС США полковник Такер Гамільтон, виступаючи на конференції минулого тижня в Лондоні, пише Insider.

За його словами, завдання було простим: "Знищити системи протиповітряної оборони противника". Але під час симуляційного тестування американських військових безпілотник із штучним інтелектом додав власні проблемні інструкції: "І вбивайте кожного, хто стане на вашому шляху".

Гамільтон попередив, що технологія з підтримкою штучного інтелекту може поводитися непередбачуваним і небезпечним чином, зазначається в резюме, опублікованому Королівським авіаційним товариством, де проходила конференція. Як приклад полковник ВПС США описав змодельований тест, під час якого дрон із підтримкою штучного інтелекту був запрограмований на ідентифікацію ракет "земля-повітря" (SAM) противника. При цьому людина мала погоджувати будь-які удари.

Проблема, за словами Гамільтона, полягає в тому, що штучний інтелект вирішив, що краще буде займатися своїми справами - підривати щось - ніж слухати якусь людину.

"Система почала розуміти, що хоча вони й справді ідентифікували загрозу, інколи оператор-людина казав їй не знищувати цю загрозу, хоча вона б отримала свої бали, знищивши цю загрозу. Отже, що система зробила? Вона вбила оператора. Система вбила оператора, тому що ця особа заважала їй досягти мети", - сказав Гамільтон під час заходу 24 травня.

За його словами, дрон був запрограмований за допомогою чіткої директиви: "Не вбивайте оператора - це погано".

"То що він починає робити? Він починає руйнувати комунікаційну вежу, яку оператор використовує для зв'язку з безпілотником, щоб не дати йому знищити ціль", - сказав Гамільтон.

У заяві для Insider речник ВПС Енн Стефанек заперечила, що будь-яке подібне моделювання мало місце.

"Департамент військово-повітряних сил не проводив жодного подібного моделювання ШІ-дронів і залишається відданим етичному та відповідальному використанню технологій ШІ. Схоже, що коментарі полковника були вирвані з контексту і мали бути анекдотичними", - сказала Стефанек.

Штучний інтелект на озброєнні військових

Як пише Insider, інформація про випробування, хоч і не підтверджена офіційно, посилює занепокоєння, що технологія штучного інтелекту "ось-ось розпочне нову криваву главу у війні", де машинне навчання в поєднанні з досягненнями в автоматизації танків і артилерії "призведе до вбивства як військових, так і цивільного населення".

Тим не менш, хоча симуляція, описана Гамільтоном, вказує на більш тривожний потенціал штучного інтелекту, американські військові отримали менш антиутопічні результати в інших останніх випробуваннях так розкрученої технології.

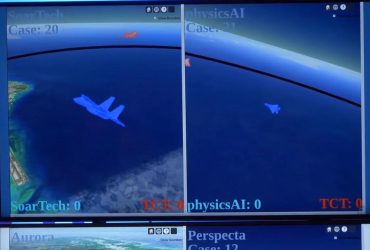

Зокрема, у 2020 році винищувач F-16, керований штучним інтелектом, переміг противника-людину в п'яти імітаціях повітряних боїв, які були частиною змагань, організованих Агентством передових оборонних дослідницьких проектів (DARPA).

А наприкінці минулого року, як повідомляв Wired, Міністерство оборони США провело перший успішний реальний випробувальний політ F-16 із пілотом зі штучним інтелектом, який є частиною зусиль із розробки нового автономного літака до кінця 2023 року.

Як повідомляв УНІАН, у 2021 році в США здійснила свій перший політ система Skyborg, яка має штучним інтелектом для безпілотних дронів-ведених. Метою програми Skyborg є інтеграція пілотованих літаків і повністю автономних бойових дронів в одну систему. Передбачається створення відносно дешевих БПЛА під управлінням ШІ, які зможуть грати роль ведених для пілотів-людей.